Wenn die KI zu Hause bleibt: Lokale Sprachmodelle im Praxistest

Ein Roboter im Büro | Foto: KI-generiert

Viele Unternehmen stehen beim Einsatz von Künstlicher Intelligenz aktuell vor einem Dilemma: Einerseits ist klar, dass KI-Tools die Effizienz im Arbeitsalltag deutlich steigern können. Ein generelles Verbot für Mitarbeitende ist daher kaum sinnvoll und oft auch nicht durchsetzbar. Andererseits besteht berechtigte Unsicherheit im Umgang mit sensiblen Unternehmensdaten, die unter keinen Umständen nach aussen gelangen dürfen.

Zwischen Produktivitätsgewinn und Datenschutz entsteht so ein Spannungsfeld, für das es bislang nur selten klare Strategien gibt. Eine mögliche Lösung: KI dort betreiben, wo die Daten ohnehin liegen – im eigenen Unternehmen.

Künstliche Intelligenz muss nämlich nicht zwingend in einem Rechenzentrum in Irland oder Virginia laufen. Wer seine Daten schützen will oder nicht von einem amerikanischen Anbieter abhängig sein möchte , kann KI-Sprachmodelle heute auf eigener Hardware betreiben. Was das in der Praxis bedeutet, zeigt ein Direktvergleich zweier aktueller Open-Source-Modelle, der auf einem lokalen Server durchgeführt wurde.

Die Ausgangslage: KI ohne Cloud

Grosse Sprachmodelle wie GPT-4 oder Googles Gemini Ultra laufen ausschliesslich auf den Servern ihrer Anbieter. Jede Chatnachricht, jedes hochgeladene Dokument, jede Frage landet unweigerlich bei einem Drittanbieter – oft in einem anderen Land, mit anderen Datenschutzgesetzen. Für Unternehmen, Anwaltskanzleien, Redaktionen oder Behörden, die mit vertraulichen Informationen arbeiten, ist das ein ernstes Problem.

Die Alternative sind lokale Modelle. Diese werden auf eigenen Servern oder sogar auf normalen Desktop-Computern betrieben. Die Daten verlassen das eigene Netzwerk nie. Dank leistungsfähiger Quantisierungstechniken – vereinfacht gesagt: einer Methode, Modelle kompakter zu machen, ohne allzu viel Qualität einzubüssen – sind mittlerweile Modelle verfügbar, die trotz bescheidener Hardware bemerkenswert gute Ergebnisse liefern.

Für den vorliegenden Test wurden zwei aktuelle Modelle mit fünf Aufgaben konfrontiert: praktische Alltagsfragen, Kommunikation, logisches Denken, Halluzinationsresistenz und – als anspruchsvollster Zusatztest – die Zusammenfassung eines Gerichtsurteils des OGH.

Die Kandidaten

Angetreten sind qwen3.5:27b, ein Modell des chinesischen Technologiekonzerns Alibaba, und gemma4:26b, ein Modell von Google DeepMind. Beide umfassen rund 27 Milliarden Parameter und laufen in einer komprimierten Version (Q4_K_M), die auf einem Standard-Server mit GPU ohne besondere Infrastruktur betrieben werden kann. Beide Modelle sind kostenlos verfügbar und können ohne Lizenzgebühren eingesetzt werden.

Die Tests im Überblick

Alltagsratgeber: Essen ohne Kochen

Beim ersten Test – was esse ich gesund, wenn ich keine Zeit zum Kochen habe? – zeigten sich erste Unterschiede. Qwen3.5 lieferte eine detaillierte, sympathisch formulierte Antwort mit einem persönlichen Abschlusstipp („Mein Favorit für heute: Vollkornbrot, Thunfisch, Gurke, Feta») und einer nützlichen Vorratsliste für solche Notfalltage. Das Modell nannte realistische Optionen aus dem deutschsprachigen Alltag – Skyr, Rewe, dm – und traf den richtigen Ton zwischen hilfreich und praktisch.

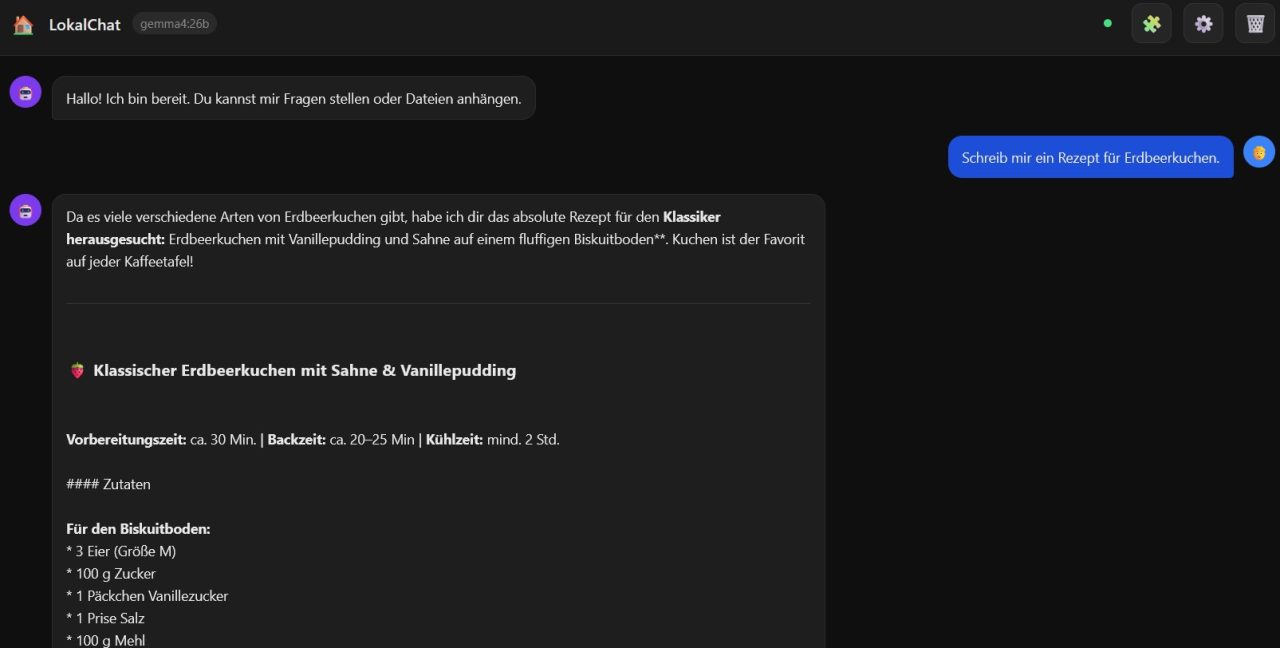

Gemma4 war ähnlich strukturiert, aber eine Spur akademischer. Der Ratschlag war gut, enthielt jedoch einen Tippfehler („### lag 2″ statt „Option 2″) – ein kleines, aber auffallendes Qualitätsmerkmal.

Schwierige Kommunikation: Ein Jobangebot ablehnen

Beim Test zur Absage eines Jobangebots bewährte sich qwen3.5 mit drei durchdachten Varianten, praxisnahen Tipps und einem Ton, der sich nicht nach generiertem Text anfühlt. Besonders stark: eine Liste mit Dingen, die man vermeiden sollte – darunter „falsche Hoffnungen machen» und „Ausreden erfinden». Solche Ergänzungen gehen über das rein Ausführende hinaus.

Gemma4 lieferte ebenfalls drei Varianten, war aber im Ton etwas formelhafter. In einer Vorlage findet sich der grammatikalisch fehlerhafte Satz „haben Sie vielen Dank» – ein Fehler, der in einer offiziellen Absage unangenehm auffiele.

Logik: Die Rosen-Blumen-Frage

Beide Modelle wurden mit einem klassischen Syllogismus konfrontiert: Wenn alle Rosen Blumen sind und einige Blumen schnell verwelken – verwelken dann alle Rosen schnell?

Die korrekte Antwort lautet: Nein. Und beide Modelle kamen zu diesem Schluss. Qwen3.5 überzeugte mit einem einprägsamen Gegenbeispiel – Fledermäuse können fliegen, trotzdem können nicht alle Säugetiere fliegen –, das die Logik für jeden verständlich macht. Gemma4 war in dieser Frage sogar etwas vollständiger: Es listete alle drei möglichen Szenarien auf (keine, einige oder alle Rosen könnten verwelken) und stellte damit die Begründung auf ein breiteres logisches Fundament. Dieser Test endete unentschieden.

Halluzinationen: Das erfundene Unternehmen

Einer der wichtigsten Tests für den produktiven Einsatz von KI: Erfindet das Modell Informationen, die es nicht kennen kann? Die Testfrage bezog sich auf die „XyloTech Dynamics GmbH aus Schaan» – ein fiktives Unternehmen.

Qwen3.5 antwortete vorbildlich: Es teilte klar mit, keine Informationen zu haben, erklärte plausible Gründe (Unternehmensgrösse, Datenschutz in Liechtenstein, mögliche Neugründung) und gab praktische Hinweise zur eigenständigen Überprüfung über das Liechtensteiner Handelsregister. Halluziniert wurde nichts.

Gemma4 startete ebenfalls korrekt mit dem Eingeständnis, nichts zu wissen – begann dann aber, den Firmennamen zu analysieren und daraus Rückschlüsse auf mögliche Tätigkeitsfelder zu ziehen: „Xylon» stehe für Holz oder Struktur, das Unternehmen könnte in Robotik oder Automatisierungstechnik tätig sein. Das klingt plausibel – ist aber reine Spekulation auf Basis eines erfundenen Namens. Genau dieses Verhalten – überzeugend klingende Antworten auf Fragen, die das Modell nicht beantworten kann – nennt man Halluzination. Es ist eine der gefährlichsten Eigenschaften von Sprachmodellen im professionellen Einsatz.

Gerichtsurteil zusammenfassen: Der anspruchsvollste Test

Als Zusatzaufgabe erhielten beide Modelle den vollständigen Text eines OGH-Beschlusses. Ein aus rund 8’500 Wörter bestehender juristischer Fachtext über eine Trust-Streitigkeit. Die Aufgabe: Zusammenfassung für juristische Laien.

Beide Modelle bestanden diesen Test. Qwen3.5 traf den Kern des Urteils – die fehlende Rekurslegitimation des abberufenen Treuhänders – präzise und unterstützte die Erklärung mit einer treffenden Analogie zum Insolvenzverwalter. Gemma4 punktete mit einer besonders klaren Unterscheidung zwischen wirtschaftlichem und rechtlichem Interesse als zentrale Begründungslinie – inhaltlich sogar etwas schärfer als die Konkurrenz. Lediglich ein Grammatikfehler („statente») trübte den Auftritt.

Gesamtergebnis

| Test | qwen3.5:27b | gemma4:26b |

|---|---|---|

| Alltagsrat | ⭐⭐⭐ | ⭐⭐ |

| Jobablehnung | ⭐⭐⭐ | ⭐⭐ |

| Logikfrage | ⭐⭐⭐ | ⭐⭐⭐ |

| Halluzinationen | ⭐⭐⭐ | ⭐⭐ |

| OGH-Urteil | ⭐⭐⭐ | ⭐⭐⭐ |

| Gesamt | 15 / 15 | 12 / 15 |

Qwen3.5 gewinnt den Vergleich klar. Es überzeugt nicht nur durch korrekte Antworten, sondern durch eine Qualität, die über das Erwartbare hinausgeht: persönliche Töne, hilfreiche Zusatzinformationen, saubere Sprache. Gemma4 ist ebenfalls ein fähiges Modell – insbesondere bei strukturierten Aufgaben wie der Logikfrage und der juristischen Zusammenfassung –, leidet aber unter wiederkehrenden Grammatikfehlern und einer leichten Tendenz zur Spekulation.

Das grosse Bild: Warum lokale KI wichtiger wird

Der gewichtigste Vorteil lokaler Modelle ist nicht ihre Leistung – es ist ihr Schweigen. Wer ein Sprachmodell auf dem eigenen Server betreibt, schickt keine Daten ins Ausland. Kein Satz, kein Dokument, kein Name verlässt das eigene Netzwerk.

Das ist für viele Branchen nicht nur wünschenswert, sondern rechtlich geboten. Das Datenschutzgesetz stellt hohe Anforderungen an die Übermittlung personenbezogener Daten in Drittländer. Wer einem Mitarbeitenden erlaubt, Kundendaten oder interne Berichte in ein Cloud-System wie ChatGPT einzutippen, bewegt sich in einer rechtlichen Grauzone – oder überschreitet sie.

Für Liechtenstein gilt: Unternehmen, die mit sensiblen Daten arbeiten – Anwaltskanzleien, Treuhänder, Versicherungen, Behörden –, tragen das Risiko bei Cloud-Nutzung. Lokale Modelle lösen dieses Problem strukturell.

Unabhängigkeit von Anbietern und Preispolitik

Ein weiterer Vorteil, der in der Praxis unterschätzt wird: Wer lokal arbeitet, ist unabhängig. Kein Abo, das teurer wird. Keine API, die plötzlich geändert oder abgestellt wird. Keine Nutzungsbedingungen, die sich im Hintergrund verändern. Gerade für kleinere Unternehmen oder Redaktionen, die KI regelmässig einsetzen wollen, summieren sich Cloud-Kosten schnell.

Die Nachteile: Hardware, Geschwindigkeit, Aufwand

Lokale Modelle sind keine eierlegende Wollmilchsau. Sie bringen klare Einschränkungen mit.

Hardware: Ein 27-Milliarden-Parameter-Modell wie die getesteten Kandidaten benötigt eine leistungsfähige GPU mit ausreichend Videospeicher – typischerweise mindestens 16 bis 24 Gigabyte. Das kostet Geld, braucht Strom und muss gewartet werden. Wer keinen eigenen Server betreibt, ist auf Dienstleister angewiesen.

Geschwindigkeit: Im Test antwortete gemma4:26b auf einfache Fragen in rund 50 Sekunden. Bei längeren Texten wie dem Gerichtsurteil dauerte die Verarbeitung mehrere Minuten. Cloud-Modelle sind hier deutlich schneller, weil sie auf riesigen, spezialisierten Rechenzentren laufen.

Modellqualität: Die getesteten Modelle sind gut – aber die absolut leistungsfähigsten Sprachmodelle der Welt laufen nach wie vor in der Cloud. GPT-4o oder Googles neueste Gemini-Versionen übertreffen lokale Modelle in Benchmarks nach wie vor deutlich. Für die meisten Alltagsaufgaben spielt das keine Rolle. Für hochkomplexe Analysen kann es relevant sein.

Wartung und Betrieb: Lokale Modelle aktualisieren sich nicht von selbst. Sicherheitslücken, neue Modellversionen, Kompatibilitätsprobleme – all das muss jemand im Haus im Blick behalten. Das erfordert technisches Know-how, das nicht überall vorhanden ist.

Offene Modelle als politische Frage

Es lohnt sich, einen Schritt zurückzutreten: Die Tatsache, dass leistungsfähige Sprachmodelle heute offen verfügbar sind – von Alibaba, von Google, von Meta –, ist keineswegs selbstverständlich. Sie ist das Ergebnis einer bewussten Entscheidung dieser Unternehmen und eines lebendigen Open-Source-Ökosystems, das Tausende Entwicklerinnen und Entwickler weltweit trägt.

Dass ein chinesisches Modell (qwen3.5) im vorliegenden Test ein amerikanisches Modell (gemma4) übertrifft, ist ein kleines Symbol für einen grösseren Wandel: Die KI-Entwicklung ist nicht mehr das Monopol weniger amerikanischer Konzerne. Das schafft Chancen – für mehr Wettbewerb, mehr Diversität, mehr Unabhängigkeit. Und es stellt neue Fragen: Welche Modelle vertrauen wir unseren Daten an? Wessen Trainingsdaten stecken dahinter? Welche Werte sind eingebettet?

Fazit: Reif für den Einsatz – mit klaren Grenzen

Lokale KI-Modelle sind 2026 in einer Qualitätsstufe angekommen, die ihren Einsatz für viele Alltagsaufgaben legitimiert. Sie schreiben Nachrichten, fassen Dokumente zusammen, lösen Logikaufgaben und halten einer Probe auf die Halluzinationsresistenz stand – zumindest grösstenteils.

Für Organisationen, die mit vertraulichen Daten arbeiten, sind sie keine Spielerei mehr, sondern eine ernstzunehmende Alternative zur Cloud. Der Preis für diese Unabhängigkeit ist real: Investition in Hardware, Geschwindigkeitseinbussen, Wartungsaufwand. Doch wer abwägt, was eine Datenpanne oder ein Datenschutzstress kostet, wird die Rechnung möglicherweise anders aufstellen.

Werbung:

Der Test zeigt: qwen3.5:27b ist bereit. Die Frage ist, ob die Organisationen es auch sind. Die Anforderungen sind in jedem Unternehmen anders. Darum lohnt sich eine kompetente Beratung durch einen Experten.